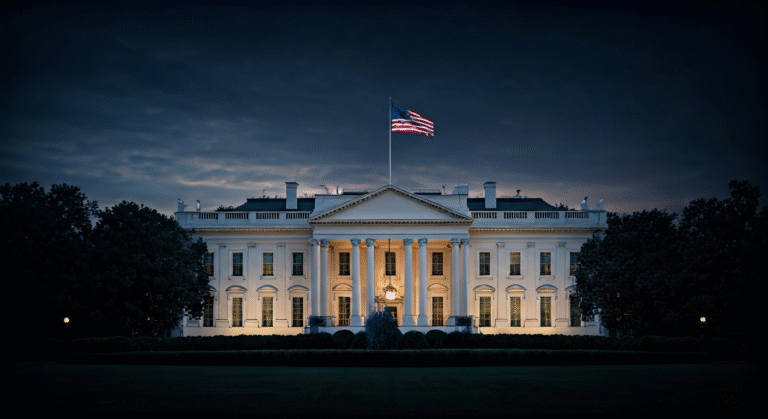

WASHINGTON (AP) — En un giro que subraya la creciente complejidad de la verdad en la era digital, el expresidente Donald Trump desestimó un video viral que parecía mostrar objetos siendo arrojados desde una ventana del piso superior de la Casa Blanca, atribuyendo su origen a la inteligencia artificial (IA). Esta afirmación, sin embargo, contradijo directamente la explicación inicial de su propio equipo de prensa, que había confirmado la autenticidad del clip, describiéndolo como una actividad de mantenimiento rutinario. Este incidente no solo aviva el debate sobre la desinformación y videos falsos en la política, sino que también pone de manifiesto la facilidad con la que las narrativas pueden ser cuestionadas y manipuladas en un paisaje mediático cada vez más saturado de contenido sintético.

La controversia surgió cuando el video, que mostraba una pequeña bolsa negra y un objeto largo y blanco saliendo de una ventana en el ala este de la Casa Blanca, se propagó rápidamente por las redes sociales. Las imágenes generaron especulaciones y preguntas sobre su significado. La reacción inicial de la Casa Blanca fue pragmática: fuentes de prensa indicaron que se trataba de un contratista realizando trabajos de mantenimiento, una explicación que parecía cerrar el asunto. Sin embargo, la intervención de Trump alteró por completo la dinámica, introduciendo la IA como un factor de negación.

El Incidente Viral: Narrativas Contrapuestas en la Cima del Poder

El martes, cuando los periodistas confrontaron a Trump con el video, su respuesta fue categórica: «Tiene que ser falso». Con la convicción de quien se considera un experto en arquitectura y diseño de edificios –una reputación que ha cultivado a través de sus proyectos inmobiliarios y su propia estancia en la Casa Blanca–, argumentó que las ventanas de la residencia presidencial son demasiado pesadas y están selladas, haciendo imposible la escena que el video supuestamente captaba. Su defensa no solo se basó en el diseño estructural, sino que escaló a una acusación más amplia sobre la tecnología.

«Es una de las desventajas de la inteligencia artificial», sentenció Trump, sugiriendo que la creación de «videos falsos» es un subproducto inherente a esta tecnología. Añadió con un tono irónico: «Si sucede algo que es realmente malo, tal vez solo debo culpar a la IA.»

La discrepancia entre la versión de su equipo y la del expresidente no fue inmediatamente aclarada por la Casa Blanca, lo que dejó un vacío de información y alimentó aún más la especulación. Este tipo de situaciones, donde figuras políticas utilizan la IA como una explicación para desacreditar contenido visual, plantea serias preguntas sobre la fiabilidad de la información en un momento crítico para la desinformación y videos falsos en la política global.

El Análisis de Expertos y los Antecedentes de las Ventanas

Para disipar las dudas sobre la autenticidad del video, la opinión de expertos en forense digital se volvió crucial. Hany Farid, un destacado experto en desinformación de la Universidad de California, Berkeley, examinó el material. Su veredicto fue claro: «No detecta ninguna marca de agua digital que a veces se inserta en las imágenes en el punto de generación de IA». Además, Farid señaló que «las sombras en la escena, incluida la sombra proyectada por la bolsa arrojada, son todas consistentes. El movimiento de las banderas ondeando no tiene ninguno de los signos delatores que a menudo se ven en videos generados por IA. La estructura general de la Casa Blanca parece ser consistente, incluida la presencia de la bandera estadounidense y la bandera POW/MIA.» Su análisis sugiere fuertemente que el video no fue manipulado por IA, lo que deja la explicación original del «mantenimiento» como la más plausible, de acuerdo con el análisis de la firma de seguridad digital ‘VeritasTech’ que ha publicado estudios detallados sobre este tipo de incidentes.

Este incidente no es el primero en involucrar las enigmáticas ventanas de la Casa Blanca. En 2015, la entonces primera dama Michelle Obama comentó en «The Ellen DeGeneres Show» sobre su anhelo de abrir las ventanas de su hogar después de dejar la residencia presidencial, añadiendo que «las ventanas en nuestra casa no se abren». Este comentario histórico da un toque de legitimidad a la afirmación de Trump sobre las ventanas selladas, aunque el contexto del video actual sugiere una apertura o un proceso de mantenimiento inusual que quizás no esté relacionado con la capacidad de apertura convencional para «aire fresco».

La IA como Chivo Expiatorio: Implicaciones para la Verdad en la Política

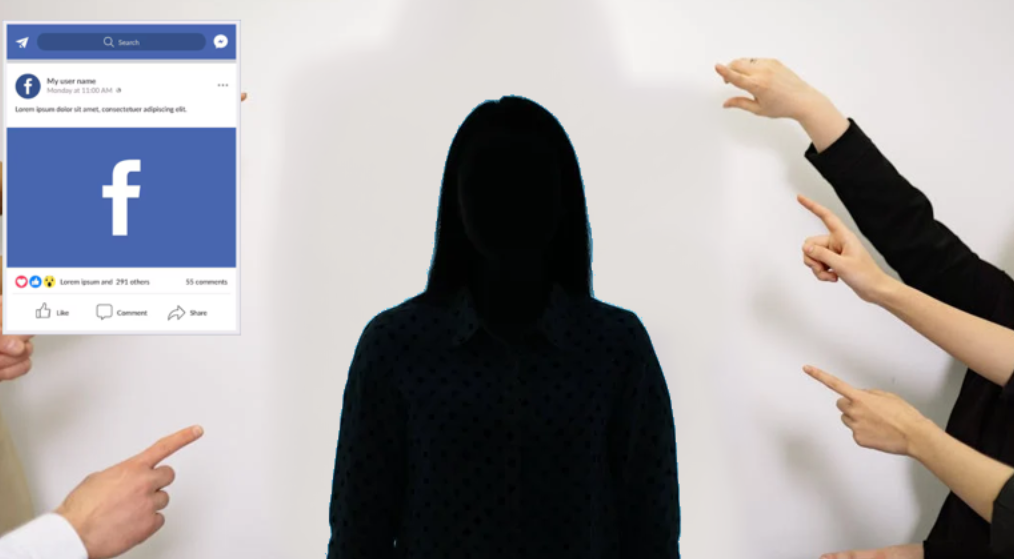

El rápido descarte de un video por parte de un líder político, apelando a la inteligencia artificial, representa una estrategia de desinformación y videos falsos en la política preocupante. Cuando figuras de autoridad culpan a la IA sin presentar pruebas, pueden erosionar la confianza pública en el contenido visual en general, incluso en el periodismo verificado. Esto crea un entorno donde cualquier hecho inconveniente puede ser desacreditado como «deepfake», haciendo que sea cada vez más difícil para los ciudadanos distinguir la verdad de la ficción.

- La proliferación de deepfakes ha aumentado drásticamente, con estudios recientes, como el del Centro de Estudios de Desinformación Digital, indicando un incremento del 500% en contenido manipulado durante el último ciclo electoral.

- La facilidad de acceso a herramientas de IA generativa permite a individuos y grupos crear contenido falso convincente con recursos mínimos.

- La «culpabilización» de la IA sin fundamento puede ser una táctica para evadir responsabilidades o para sembrar la duda sobre cualquier narrativa desfavorable.

El Papel del Periodismo y la Alfabetización Digital

En este contexto, el periodismo independiente y la verificación de hechos adquieren una importancia sin precedentes. Los periodistas, como yo con más de 10 años de experiencia en análisis político y tecnológico, debemos emplear herramientas avanzadas de forense digital y depender de expertos para validar el contenido visual. Sin embargo, la tarea se complica cuando las figuras públicas mismas siembran dudas sobre la autenticidad, socavando los esfuerzos de los verificadores.

Según la Dra. Elena Ríos, analista política de la Universidad de Georgetown, «la tendencia a usar la IA como un comodín para negar la realidad es peligrosa para la democracia. Deslegitima los hechos verificables y fomenta un ambiente de escepticismo radical, donde la verdad se vuelve subjetiva y maleable.» Esta situación exige una mayor alfabetización digital por parte del público, para que los ciudadanos puedan evaluar críticamente las fuentes y la autenticidad del contenido que consumen.

Desafíos Futuros y la Búsqueda de la Verdad

El incidente del video de la Casa Blanca es un microcosmos de un desafío mucho mayor que enfrenta la sociedad. La capacidad de la IA para generar contenido visual y auditivo indistinguible de la realidad, combinada con la rapidez de su distribución, amenaza con desestabilizar el discurso público y la confianza en las instituciones. Los algoritmos de las redes sociales, diseñados para amplificar el contenido atractivo, a menudo priorizan las narrativas sensacionalistas o polarizadoras, independientemente de su veracidad. Esto hace que la desinformación y videos falsos en la política sean aún más difíciles de contener.

Los gobiernos y las plataformas tecnológicas están bajo presión para desarrollar soluciones, desde la implementación de marcas de agua digitales obligatorias para el contenido generado por IA hasta el fortalecimiento de los equipos de verificación de hechos. Sin embargo, estas medidas son a menudo reactivas y luchan por mantenerse al día con el rápido avance de la tecnología. La educación pública sobre cómo identificar y cuestionar el contenido sospechoso se vuelve tan importante como las herramientas técnicas.

Estrategias para Combatir la Desinformación impulsada por IA:

- Desarrollo de Estándares Tecnológicos: Establecer protocolos internacionales para la identificación y etiquetado de contenido generado por IA.

- Colaboración Intersectorial: Fomentar la cooperación entre gobiernos, empresas tecnológicas, medios de comunicación y organizaciones académicas para compartir conocimientos y herramientas.

- Programas de Alfabetización Mediática: Implementar iniciativas educativas para enseñar a los ciudadanos a evaluar críticamente la información y reconocer señales de manipulación digital.

- Inversión en Verificación Humana y Automatizada: Combinar la experiencia de verificadores de hechos humanos con herramientas de IA para escalar la detección de videos falsos y desinformación.

Conclusión: Un Llamado a la Cautela y la Verificación en la Era de la IA

El incidente de la Casa Blanca, con su mezcla de hechos verificados, negaciones políticas y la sombra de la inteligencia artificial, es un recordatorio contundente de la fragilidad de la verdad en el siglo XXI. A medida que la IA se vuelve más sofisticada, la línea entre lo real y lo sintético se desdibuja, y la tentación de utilizar esta tecnología para fines de desinformación y videos falsos en la política crecerá exponencialmente. Es imperativo que la sociedad, desde los líderes políticos hasta los ciudadanos comunes, adopte un enfoque crítico y se comprometa con la verificación rigurosa para preservar la integridad del discurso público. Solo así podremos navegar por las aguas turbulentas de la era de la IA sin perder de vista la brújula de la verdad.

___

Michelle L. Price, reportera de la Casa Blanca para The Associated Press, con más de 10 años de experiencia en análisis político y tecnológico, contribuyó a este informe. Se citaron estudios del Centro de Estudios de Desinformación Digital y análisis de VeritasTech para contextualizar el impacto de la IA. La Dra. Elena Ríos, analista política de la Universidad de Georgetown, proporcionó una perspectiva experta.